摘要生成中

AI生成,仅供参考

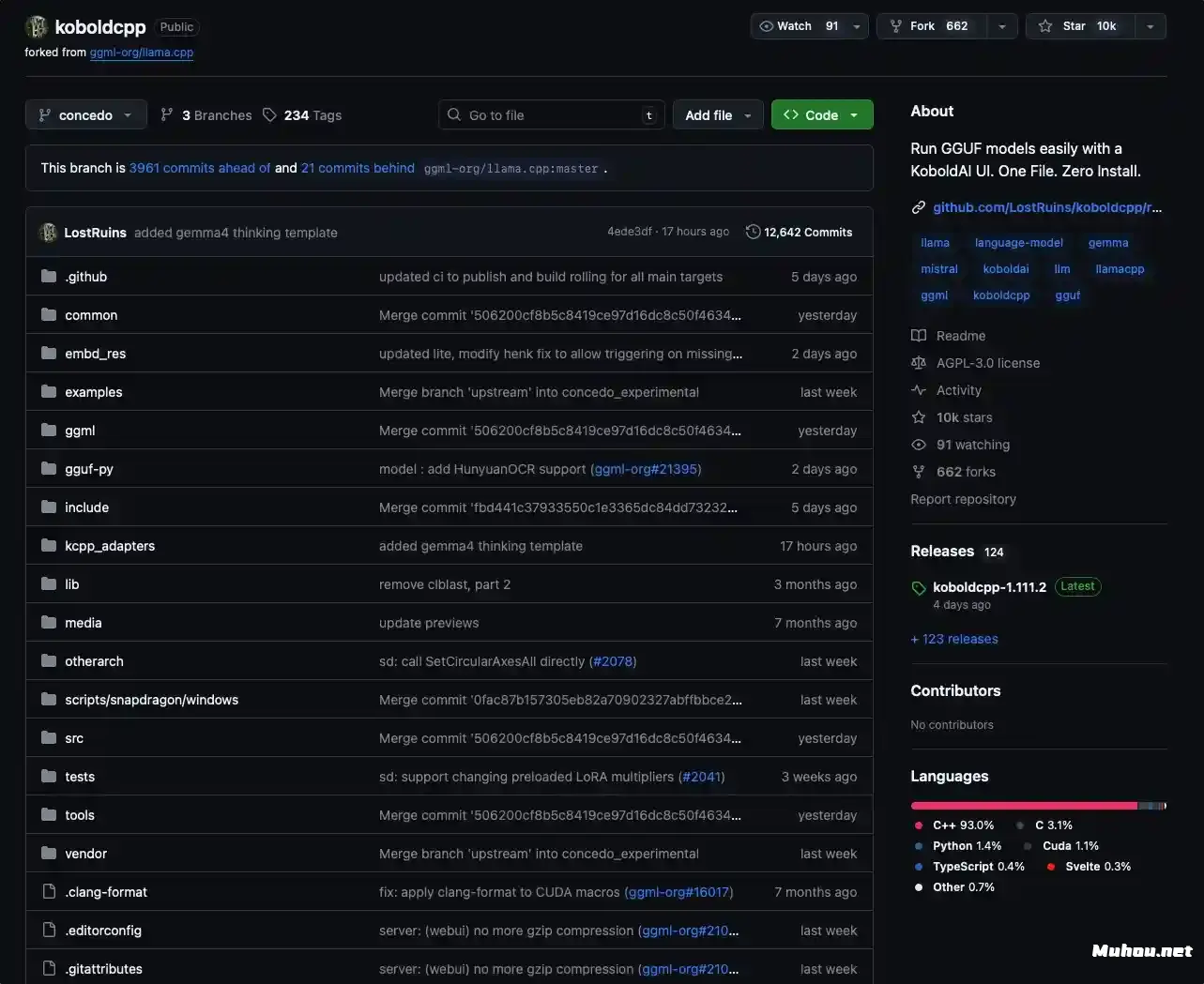

顶级缝合怪的终极觉醒:Koboldcpp,新手勿入”

如果你厌倦了 Ollama 的封闭,又搞不定原生 Llama.cpp 的代码编译,那么 Koboldcpp 就是你本地 AI 旅程的终点站。 它不仅是一个推理引擎,更是本地 AI 圈最强大的“万能胶水”。不管你是 N 卡、A 卡、英特尔核显还是纯 CPU 玩家,Koboldcpp 都能让你体验到什么叫“万物皆可对接”。

🛠️ 为什么它是“缝合怪”的终极梦想?

- 单文件即巅峰: 无需安装 Python,无需配置虚拟环境,没有地狱级的依赖报错。一个

.exe文件,解压即用。 - 硬核兼容性: 它是 GGML 和 GGUF 格式的头号玩家。支持 NVIDIA (CUDA)、AMD (ROCm/Vulkan)、Intel (CLblast)、Apple Silicon (Metal)。显存不够?内存来凑,GPU+CPU 混合推理带你飞。

- 万能 API 对接: 这是它最强的地方。它提供完美的 OpenAI 兼容接口。你可以把它作为后端,对接 SillyTavern (酒馆) 玩深度角色扮演,对接 LibreChat 搞私有 GPT,甚至对接各种翻译插件。

- 多模态缝合: 谁说它只能聊天?它内置了 Stable Diffusion 支持,聊着聊着就能让 AI 给你发一张它现在的“自拍照”;接入视觉模型,它还能帮你识别屏幕截图。

📦 选对版本,给硬件一个交代

- 高性能 N 卡玩家: 选

koboldcpp_cu12.exe,CUDA 加速让推理速度榨干显存。 - 全家桶玩家 (A/I/老N卡): 选

koboldcpp.exe,开启 Vulkan 模式,兼容性直接拉满。 - 极致办公/老电脑: 选

koboldcpp_nocuda.exe,纯 CPU 跑 OpenBLAS,慢是慢点,但稳如老狗。

🚀 “缝合怪”进阶指南

- 选模: 去 HuggingFace 搜 DeepSeek-GGUF。新手建议从 7B 或 8B 起步,12GB 显存玩家尝试 14B,顶级玩家直接冲 32B 以上。

- 调教: 在

Hardware选项卡把GPU Layers拉满(显存够大的话),启动后的 Web UI 里可以精细调节Temperature、Top-P等参数。 - 出圈: 拿到本地

http://localhost:5001的 API 地址,去缝合你的 SillyTavern 吧。加载角色卡,设定世界观,这才是本地 AI 的完全体!

隐私归你,折腾归你,快乐归你。 Koboldcpp v1.109.2,支持最新 DeepSeek 内核,你的本地 AI 完整人生,从这里开始。