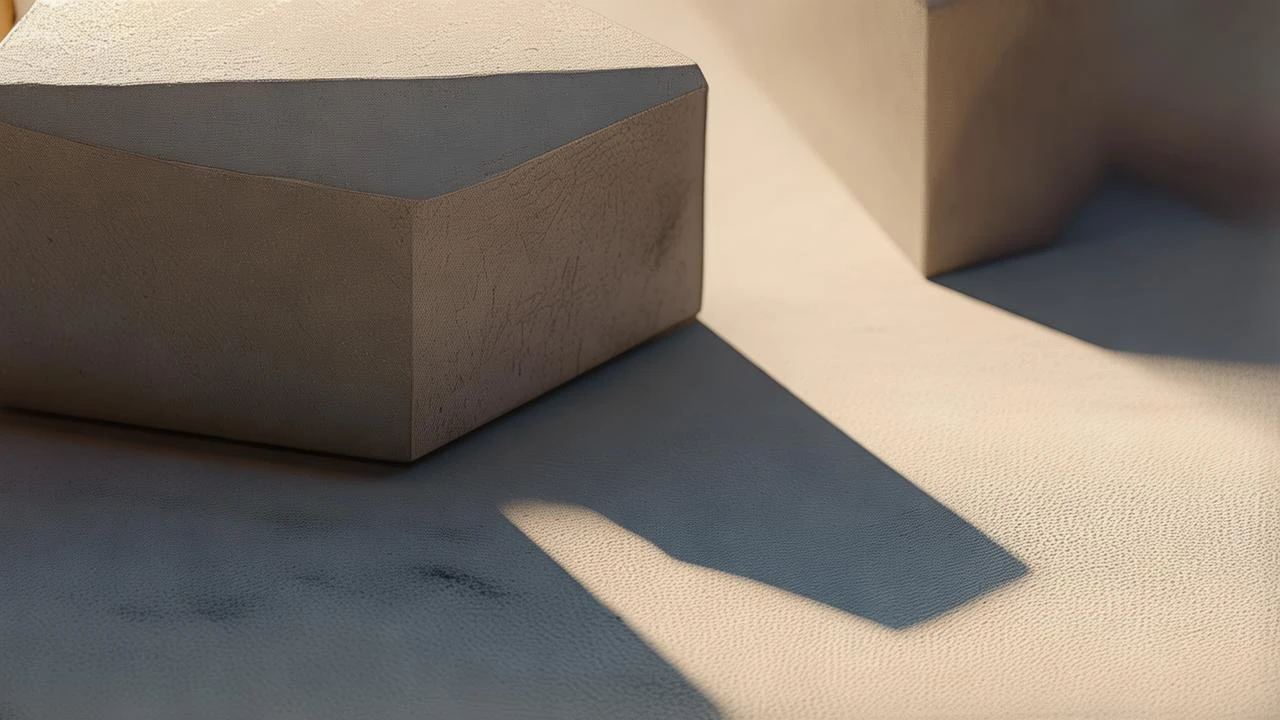

光线追踪阴影实现原理

当屏幕上出现一个逼真的阴影时,它往往不仅仅是“暗一点”那么简单。那从物体边缘柔和地弥散开来的渐变,那在复杂几何体下方精确交错的轮廓,都指向一种被称为“光线追踪”的技术。它彻底改变了计算机生成阴影的方式,从模拟走向了仿真。

从“贴”阴影到“算”阴影

在光线追踪普及之前,主流的阴影技术,如阴影映射(Shadow Mapping),本质上是一种“障眼法”。它预先从光源视角渲染一张深度图,然后在相机渲染时,将像素点坐标转换到光源空间去比较深度,以此判断是否在阴影中。这方法很快,但问题不少:你需要处理分辨率带来的锯齿(阴影锯齿),自阴影的痤疮瑕疵,还有处理半透明物体时的各种麻烦。说白了,这是一种基于二维图像的近似,精度和物理正确性上打了折扣。

一条光线的阴影之旅

光线追踪的思路则截然不同,它直接模拟了现实世界阴影产生的物理过程。想象一下,你眼睛(相机)看到屏幕上的一个像素点P。传统渲染会问:“这个点是什么颜色?”而光线追踪会多问一句:“照亮这个点的光,有没有被挡住?”

具体实现上,渲染器会从相机出发,穿过像素P发射一条“视线”(Primary Ray)。当这条视线击中场景中的某个物体表面点A时,算法不会就此止步。它会从点A向光源(比如太阳或灯泡的位置)再发射一条“阴影射线”(Shadow Ray)。这条射线的使命很单纯:看看点A和光源之间有没有其他物体挡道。

- 如果阴影射线畅通无阻地抵达光源,那么点A就被直接照亮,计算光照颜色。

- 如果阴影射线在途中击中了另一个物体B,那么点A就位于物体B的阴影之中。此时,点A的颜色将不包含该光源的直接光照贡献,它可能只接受环境光或来自其他光源的光。

软阴影的奥秘:面积光源

现实中的阴影为什么有柔和的边缘(半影区)?因为大部分光源,比如窗户、灯罩,都不是一个无限小的点,而是有面积的。光线追踪能优雅地模拟这一点。算法不再只向光源中心发射一条阴影射线,而是向整个光源面积上随机发射多条(比如几百条)射线。

统计这些射线的“命中率”:如果全部被遮挡,点A在全影区(本影);如果部分被遮挡,点A在半影区,其明暗程度与未被遮挡的射线比例成正比。正是这种基于物理的采样,产生了从锐利到柔和、过渡无比自然的阴影边缘,这是传统技术很难廉价实现的。

性能的代价与优化之战

物理上的精确,带来的是计算上的昂贵。场景中每增加一个光源,每个着色点就可能需要多发射数十甚至数百条射线。每条射线都需要与场景中所有几何体进行求交测试(Ray-Scene Intersection),这是最耗时的部分。因此,光线追踪长期是离线渲染(如电影特效)的专利。

其真正的普及,离不开两项关键加速技术:包围盒层次结构(BVH)和硬件加速。BVH通过将场景物体组织成树状结构,让射线能快速排除大量不可能相交的几何体,将求交计算从O(N)复杂度降至接近O(log N)。而现代GPU(如NVIDIA的RT Core)则内置了专门的硬件单元来高速处理射线与BVH的遍历和求交计算,这才让实时光线追踪成为可能。

如今,你在游戏里看到的一缕穿过百叶窗的午后阳光,其下错综复杂的柔和阴影,背后正是亿万条阴影射线在BVH结构中穿梭查询的结果。这不是魔术,而是无数次“光线-三角形”求交测试堆砌出的真实。

参与讨论

暂无评论,快来发表你的观点吧!